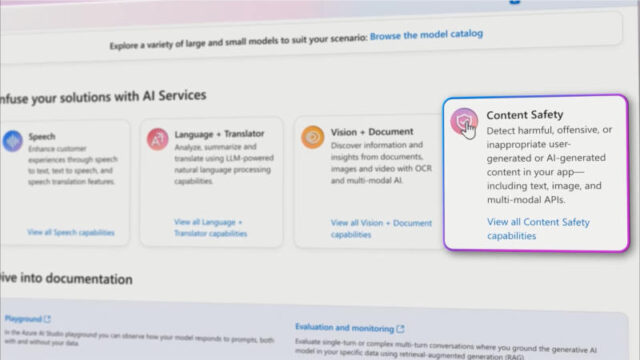

Microsoft Azure bulud infrastrukturunda yeni Məzmun Təhlükəsizliyi funksiyasını təqdim etd.Bu, generativ süni intellektin işində uğursuzluqlarla mübarizəyə yönəlib. Xüsusiyyət AI modellərinin cavablarında səhvləri avtomatik aşkar edir və hətta düzəldir.

Məzmun Təhlükəsizliyi zəiflikləri aşkar etmək, süni intellekt sistemlərində hallüsinasiyaları aşkar etmək və istifadəçilərin yersiz sorğularını bloklamaq üçün nəzərdə tutulmuş təhlükəsizlik alətləri dəsti olan Azure AI Studio-da ilkin baxışda mövcuddur. Məzmun Təhlükəsizliyi süni intellekt cavablarını skan edir və çıxışı müştərinin daxiletməsi ilə müqayisə edərək onlarda qeyri-dəqiqlikləri müəyyən edir.

Səhv aşkar edildikdə, sistem onu vurğulayır, təqdim olunan məlumatın niyə yanlış olduğu barədə məlumat verir və problemli məzmunu yenidən yazır — bütün bunlar istifadəçi qeyri-dəqiqliyi görməzdən əvvəl. Bununla belə, bu funksiya etibarlılığa zəmanət vermir. Google Vertex AI korporativ platforması həmçinin Google-un axtarış sistemi, şirkətin öz məlumatları və gələcəkdə üçüncü tərəf məlumat dəstləri ilə cavabları yoxlamaq yolu ilə AI modellərini “zəminləşdirmək” funksiyasına malikdir.

Microsoft Məzmun Təhlükəsizliyi sistemi böyük və kiçik dil modellərindən istifadə edərək cavabları əsas sənədlərlə əlaqələndirir, bir şirkət nümayəndəsi dedi, lakin səhvlərdən qorunmur. “Qeyd etmək vacibdir ki, torpaqlama [səhv aşkarlanması] “dəqiqlik” problemini həll etmir, lakin bu, generativ süni intellekt cavablarını əsas sənədlərlə uyğunlaşdırmağa kömək edir”, — deyə Microsoft izah edib.